“端闻”podcast 的报导和制作都依赖端传媒会员的订阅付费支持。如果你喜欢我们的播客报导,请点击登入订阅会员,支持我们持续产出,也让更多人通过音频获取深度报导和多元观点。

收听并关注“端闻”YouTube | Apple Podcasts | Spotify 或使用节目的 RSS Feed,,在任意播客应用订阅收听。

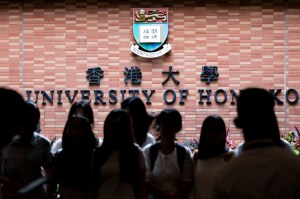

今年七月,香港大学一名法律系男学生被控用 AI 软件生成上百张色情照片。 他抓取身边女性在社交平台上的相片,未经同意,擅自加工。涉事的合成照及素材照片多达700张、受害女性为20至30人。这起事件被曝光之后,舆论哗然。

随着 AI 技术的不断提升,利用Deepfake制作色情影像的门槛和成本都在不断降低,相关犯罪越来越多,防不胜防。 在这样的背景下,香港及各地的现行法规,能否应对不断出现的“数位性暴力”?

本期“端闻”,端传媒记者郑淑华整理港大Deepfake色情照事件脉络,探讨香港及世界各地有关深伪的现行法规。

期待你跟我们分享想法,邮箱地址:podcast@theinitium.com

【制作团队】

出品:端传媒音频

监制:甯卉

主持:甯卉

编辑:HY、陈莉雅

制作人:Kelly

剪辑、声音设计:王伯维,“缰河媒体工作室”Alex Sun、阿狗

主题音乐:Axel Kacoutié

评论区 0