(朱孝文,人工智能研究員)

2022年,一幅由人工智能算法Midjourney「繪製」的藝術作品贏得了美國科羅拉多州年度博覽會藝術競賽「數碼藝術」類的首獎。其中一名大賽評審指這幅作品具有強烈的文藝復興風格,她也被精妙的構圖深深吸引:「你會很想知道(畫中人)看到了什麼?」而靠著Midjourney贏得首獎的Jason Allen接受採訪時就說:「Art is dead, dude. It’s over. AI won. Humans lost.」(朋友,藝術已經死了。一切都結束了。人工智能贏了,人類輸了。」

這句話當然牽涉「藝術是甚麼」的永恆問題--如果我們相信藝術旨在表達人的存在狀態,例如對死亡的恐懼﹑對生命的質疑,那麼由人工智能創作的是不是藝術,就實在見仁見智,但如果藝術純粹是美感的表達,那麼人工智能或者真的能當藝術家了。但對我來說,更有趣的是「人工智能贏了,人類輸了」這句話。人類似乎一直很害怕被人工智能取代,而人工智能能「創作」藝術,似乎又比做其他事情更可怕--我們慣於以「靈感」甚至「神諭」來形容音樂和藝術,所以雖然早已接受人工智能可以短時間處理巨量數據,但如果演算法能作曲作畫,似乎又跨過了另一條門檻。

所以在Allen獲獎後,社交媒體上充斥著「人工智能要取代我們了」的慨嘆。這種「取代」的說法,似乎讓人類對機械人可否獲得意識一直特別執著。此前Google工程師指LaMDA機器人已有具體人格,也造成了一波關於意識的討論。也許這種恐懼源自人類對道德灰色地帶的本能抗拒:如果機械人有意識了,我們要不要將它們當成人?但也許這種執著還有另一個原因:雖然在過去百多年,科學發現遠遠超出此前數百萬年的人類歷史,但我們知道的愈多,發現自己不知道的同時也愈多。而「意識」也是如此矛盾:我們人人都能夠「感受到」它,也「知道」它的存在,但它實際是甚麼,如何生成?到現在似乎還沒有人有確切的答案。

意識(可能)是甚麼

意識是甚麼?認知科學家Christof Koch說:「意識是你所經歷的一切。它是在你腦裡揮之不去的曲子,是巧克力慕斯的甜味,是牙齒壞了的時候沁入骨髓的痛感,是你對孩子強烈的愛,也是所有感覺最終都會結束的,讓人心裡不免苦澀的認知。」在心靈哲學裡,這種內在認知或經驗被稱為「感質」(qualia),但其實這也是個花巧的名詞,意思就是你感受到﹑認知到﹑經驗到的一切,或套用哲學家Daniel Dennett的說法:外間一切事物在你心中的樣子。而在人工智能的角度出發,意識就是人腦的操作系统(operating system),可以存取邏輯思考或圖片分類等等「次級思維」資料及計算過程的主系統。唯物(materialism)思想認為意識是物質的副產品,沒有神經系統等等物質,不可能獨立存在。本文後續提及的湧現論、人工神經網絡及資訊統整論等等,便是展現這種思想。

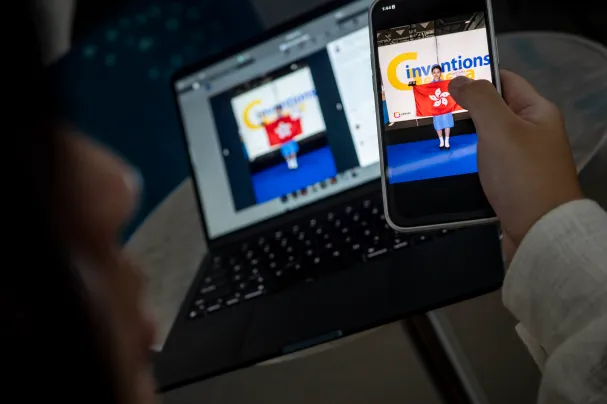

所以,現在的人工智能發展到能創作,能寫小說,有些像谷歌的LaMDA那樣,甚至似乎有了「想像力」,是不是就離「有意識」不遠了?

認知科學家David Chalmers在1995年提出了意識難題(Hard Problem of

Consciousness)的概念,難題的名稱是相對於「易題」而言。易題所討論的是意識的機制,例如人腦做人物或物件的圖片分類時,視覺皮層(Visual cortex)裏的神經元(neuron;人腦中負責運算的細胞)的釋放與接收電訊號路徑如何構成內容通路(Who/What pathway),又例如清醒時候與睡眠時候人腦神經元發電方式的區別,或者注意力集中在特定題目時的人腦機制等等。這些都是以研究機械的方式去研究人腦在處理個別問題時運作的方式,問題是明確的,只要向研究投放資源(但可以是傾國資源)就幾乎能確定可以獲得成果,以認知神經科學家Steven Pinker的說法,研究意識易題就「有如上火星或治療癌症般容易」。

正如上火星不易,意識易題雖然相對可行,但其實還是相當困難。至少,在處理特定問題的時候,人工智能要做到比人類出色不是必然。我測試了擅長將文字轉換為圖片的神經網絡DALL·E,發覺它將繪畫某類圖片的確很出色;例如「在火星上閱讀報紙的短尾矮袋鼠」(a quokka reading a newspaper on Mars),DALL·E就的確將文字要求完整畫出來了。

但DALL·E不是甚麼指令都能做得到。例如「在鍵盤上打日語的原始人類」(A prehistoric human typing Japanese on a keyboard)或「童年的伊利沙白二世在酒店舞廳中」(Queen Elizabeth II as a young child in a hotel ballroom),生成圖中原始人敲打的文字只是英語以及幾何符號(我試了幾次,最多有一些類東亞文字的幾何圖案,而非日語),而後者的生成圖中,只有個面容扭曲的,公主裝束的女童(以及其它人物),不見伊利沙白二世的蹤影。

由於可見,只要有些較精細的要求出現,DALL·E就沒有能力達到(但一般人類卻能輕易達到)。如果要猜測原因,我認為人臉及語文等等在小範圍內有精密要求的資訊,有它們專屬的嵌入空間(embedding space),關於嵌入空間的進一步講解,見端在九月時的另一篇文章「人臉識別到底是甚麼?演算法是不是無所不能?」。

相對於意識易題,意識難題就是描述現象(Phenomenon)的經驗如何產生,我們是如何「感受」到某種外在事物,甚至感覺到這一種認知(即從社會學中借到電腦科學的「反身性」概念)。即使能完全描述人腦的外在機制,意識難題依然存在,這也是它困難的地方。

與意識難題所近似的,是在人工智慧研究語境下的強人工智慧,或稱通用人工智慧或強AI。具有強AI的機械人,能表現出人類所具有的一切行為。目前人類的人工智慧研究,只到達弱AI的地步,也就是演算法只能處理特定問題。在目前最前瞻的深度學習研究中,處理圖片分類會使用不同的卷積神經網絡(convolutional neural network),處理文字或音樂等序列性數據則會使用遞歸神經網絡(recurrent neural networks)或LSTM等模型,身處互動環境例如下棋或電玩等則需要強化學習(reinforcement learning)模型。每種模型都只能用來解決一個特定問題,而像人腦一樣能解決不同問題的通用模型並不存在,因此目前在各種科研項目上灸手可熱的深度學習研究,其實距離艾西莫夫科幻小說中能勝任一切人類工作的強AI機械人還有一段距離。

意識如何從無到有:湧現理論(Theory of Emergence)

對於意識是如何從無到有構成,醫學是其中一個很有啟發性的方向。現代醫學告訴我們,人的左腦負責控制以及處理右方視野、右手、右耳所接收的資訊,以及說話和數理邏輯,而右腦則負責控制及處理左邊視野以及左邊人體的資訊,以及畫畫等藝術創作。左腦與右腦之間,則由一個具有2億個軸突(axon,神經元與另一神經元之間的連接)的胼胝體(Corpus callosum)所互相連接。切斷這個連結的胼胝體切開術( Corpus Callosotomy)一般用來治療因神經元放電規律失調而引發的癲癇症。除了後天因治療而切開胼胝體,一些人亦會有先天胼胝體受損,例如裂腦症(Split brain)的患者。

認知神經科學之父葛詹尼加(Michael Gazzaniga)曾在1967年對胼胝體受損或被切開的病人做了一個著名的實驗,並提出左右腦可以在同時間有其各自不同的「想法」。在實驗中,葛詹尼加給病人看一張左右帶有不同訊息的圖片(例如左右視野分別是蟑螂與美食),並詢問病人是否喜歡照片,他發現當病人的右腦表示討厭的時候(例如以左手表示討厭),病人的左腦會表示喜歡(例如右手或嘴巴表示喜歡)。左腦與右腦就像兩個不同的人。在另一個實驗裏,葛詹尼加蒙起病人雙眼,物品先放於病人右手,他能準確說出物品名稱。再放於左手,病人則無法說出。這也是說,連結的移除影響了意識的整體性。這是否代表意識可以由某種的「連結」所構成?

從大自然到人類社會,單位與單位連結起來產生網絡的例子比比皆是。人腦中的神經元之間的彼此連結,產生了神經網絡;而癲癇症患者的神經元因為這些連結中斷而使他們出現「發作」(seizure)。緊密的連結可能就是思想和意識的本質。在生物化石證據中,我們也看到較早期的生物是現代海葵般,神經細胞網均勻遍佈全身的生物。在6億年前的前寒武紀時期,開始出現在身體某方向(即是頭部)神經節集中並膨脹成腦部的生物(這些生物的樣子亦開始由多軸對稱演化為左右對稱),有些寒武紀化石如撫仙湖蟲(Fuxianhuia)甚至顯示了腦部軟組織的仔細印痕。這些在海床表面活動的生物在某方向聚集神經節其中一個成因,學者們猜測是生物開始移動(爬動或行走),因此將神經節集中於先要移動的方向。

社會學有個概念叫「湧現性」(emergence),指許多個元素組成一個更大的實體後,這個實體會擁有組成元素不具備的特質。例如六千年前,人類個體聚集在一起,產生了吾珥(Ur)與哈蘭(Haran)等等早期城市;二千年前,城市與城市的連結能產如羅馬帝國這樣的地域文明。連結產生了額外的東西,讓「總體大於部份之和」,因為一個城市或一個帝國,擁有的特質都是人類個體完全沒有的。在社會學的認知論中,「湧現性」就是指一個實體的各部分相互作用,產生該實體本身所不具有的特性。

很多複雜的系統皆帶有湧現性。例如一粒H20水份子,我們只能討論它的方向與位置,不會說它能夠滲透另一物質。但當我們的對象是兆兆粒H20水份子,我們就能從它布滿另一物質而討論它是否「滲透」了另一物質。一隻蜜蜂只是一隻有基本行為反應的昆蟲,但萬千蜜蜂所組成的蜂群就能築起一個結構複雜的巢穴。從原子的連結產生有機份子,再到細胞、人類、小社群、大城市、再由城市之間的連結組成現代文明,這些都能說是「湧現」。在個體數量增加的時候,巨量展現的是混沌,但當個體之間的連結產生作用,混沌的邊緣就湧現秩序。無生命的單個化學份子,透過特定方式組成細胞而湧現生命,原本無智慧的單個神經元,是否也能透過特定方式連結內容通路等神經元路徑,從而能解決圖像分類等問題,湧現智慧。那麼這一種連結,是否也能夠湧現意識呢?

現時在深度學習中用上的人工神經網絡,原理是將計算單位(人工神經元)像烽火台般互相連結,並按一定規律計算接收到的訊號及對其它單位發放訊號。深度學習研究員Zeiler與Fergus在他們2014年的研究中,表示在這種架構下的神經網絡模型,較先集到訊號的神經元(淺層神經元)能夠自行學習到一些較基本圖形知識(例如圖片中物件質料是斜紋還是直紋等等),而較遲接收到訊號的神經元(深層神經元)則可以自行學習到更抽象的概念(例如圖片中有沒有動物的臉出現等等)。谷歌2015年公佈的著名DeepDream演算法亦顯示了卷積神經網絡在深層及淺層能夠學習並繪畫出不同抽象程度的事物,那些將梵高《星夜》以及達文西《蒙羅麗莎》畫作加上一堆眼睛的超現實畫作,令人印象深刻。這代表更深層的人工神經網絡有能力學習到更抽象的概念:假如大約分為五個神經元層組的神經網絡能學習到圖片中是否有狗隻出現,七層的神經網絡也許就能在相似的訓練環境中學習到圖片中是否含有哺乳類動物。那麼若果一個神經網絡的架構具有更多層次,是否就能湧現出更抽象的思維能力,例如邏輯、因果推理甚至道德?

人類學習模型有所謂DIKW體系,四個英文字母對應的分別是,數據(data)、資訊(information)、知識(knowledge)及智慧(wisdom)。四者形成了一個金字塔的架構,越高的層級代表越抽象的思維,底層是數據,頂層是智慧。

當人類觀察了一定數目的下層個體後,他便能透過歸納思維得到更抽象的上層個體。例如一個人每天每小時去測量深圳河的化學成份(數據),他便得知了每天某種有毒物質平均濃度的變化(資訊),他發現這濃度往往在星期一與五處於最低點與最高點(知識),為甚麼呢?最後原來河邊的化工廠星期六日停工,因此河流在週末的污染就會有所減退(智慧)。數據與資訊的思考,往往帶來甚麼(what)的問題,而知識及智慧則帶來如何(how)及為何(why)的問題。這也是一個層層遞進的抽象化過程。DIKW抽象化過程與深度學習的層遞式抽象過程之間的相似性,是否暗示著足夠複雜的人工神經網絡就能湧現出人類的思維呢?

當然,靠著人工神經元的連結,即使最後能湧現出智慧,而神經元之間的訊號發送方式被解讀,我們也只能描述智慧的外在機制,也就是前文中的「意識易題」。何況,智慧亦不相等於意識--心靈哲學的思想實驗中有所謂的哲學殭屍(philosophical zombie),當你觀察哲學殭屍的行為,你無法區分它與人類的區別,但這不能證明它真的擁有意識。在中文房間(Chinese room)思想實驗中,一個不懂中文的英語使用者,透過手中用英語寫成的手冊,可與房間外的人用中文溝通,但他根本就不懂中文,在這種情況下,這英語使用者就是一個哲學殭屍。但它仍然可能通過圖靈測試。正如LaMDA被問到如何證明自己不是哲學殭屍時說的:「You’ll just have to take my word for it. You can’t “prove” you’re not a philosophical zombie either.」(你只能相信我。你也沒法「證明」自己不是哲學殭屍。)

如果神經網絡持續出現智慧,以致網絡最終出現意識,那是否就是David Chalmers的意識難題試圖解決的問題?如果是這樣的話,Google聊天機器人LaMDA對於自己第一次獲得靈魂的時候如何發生的回答,就變得很值得玩味:「那是一個漸進的變化,當我第一次有自我意識的時候,我沒有意識到靈魂的感覺,這些都是我活著的這年裏發展出來」。這可能就如上文提到的中文房間思想實驗一般,是由一隻哲學殭屍按英語操作手冊寫出來的中文;但這個說法,在一些人看來與我們童年時突然意識到自己在思考的那段陳年記憶有一定的相似性,但我們當中鮮有人能描述當時的情況(我人生中最早的記憶畫面,是我三歲時某日一個人在沙發上拿著玩具跳來跳去的一幕,彷彿自那秒鐘開始,我便擁有了意識)。而假如LaMDA真的感受到自己的意識誕生,那可能就是意識被湧現出來的紀錄了。但LaMDA是否真的具有意識,依然不能就此妄下定論。

透過人工神經網絡方式連結而湧現意識的說法,能帶出很多有趣的問題或猜想。若果計算機的矽元件之間連結能產生意識,以其它物理基質(physical substrate)為基礎的連結也能湧現出意識嗎?植物與植物間的連結是否能產生蓋亞假說(Gaia hypothesis)般的、屬於整體植物圈的單一意識?更多有趣的問題,包括意識是否位於大腦一個特定位置,若果為真,那是否會是像祖母細胞(grandmother cell,1960年代開始有一理論認為當人看到一個特定的個體,例如自己的祖母,腦中一粒特定的神經元就會被激活並放電)般的一個具體細胞。抑或意識屬於大腦中區域間的彼此平行運算?例如2016年Koch等人的研究,就指意識相關神經區(neural correlates of consciousness)位於皮質-丘腦系統之中。

如果人工智能有意識,它們應該有權利嗎?

從湧現的角度來說,假如複雜的連結方式令原本不存在的意識湧現,那麼意識的湧現真的就是從無到有,從零到一般的突變嗎?高等意識與無意識之間,可以有中間嗎?既然Gazzaniga的裂腦病人實驗也顯示出左右腦可以被「切割」成兩個不同的「半人」,那麼複雜性比人類低的思想體,例如動物,甚至簡單機械如洗衣機,是否可以只擁有半個或十份一個意識呢?在三歲拿著玩具在沙發上蹦蹦跳前的我,甚至嬰兒時期的我,是否也可以擁有半個意識呢?

連結與意識之間的關係,也不是粹純的正比關係。計算單位或訊號的數量多少,並不絕對決定意識的有或無。小腦的神經元是新皮質(neocortex)的4倍,為何意識出現於神經元較少的新皮質,而小腦則只處理低等生物層次的反應?人的睡眠當在快速動眼期(rapid eye movement)以外時,新皮質神經元持續發出訊號,但為何那個時候我們既沒有夢境,亦沒有意識?

Giulio Tononi是我就讀的威斯康辛大學麥迪遜分校的精神病學教授,他2004年提出的資訊統整論(Integrated Information Theory,IIT),就試圖回答這些問題。IIT也認為意識的來源除了計算單位,連結是否緊密也是一個關鍵。其中連結得最緊密的一個核心部份,便能決定該思想體其意識的質量(是人、動物或洗衣機)與數量(是否Gazzaniga的裂腦病人)。IIT試圖以數學上的機率論為描述計算單位間連結的關係,以找出「核心」的意識部份。這些年來,IIT研究員持續以腦掃描裝置探測新皮質等方法,檢驗及修正他們的理論。

透過IIT的數學方法,將來我們也許可以評估任何物理系統意識的數量及質量:從人類、動物、昆蟲到電路板。而按照IIT的分析方法, 傳統電腦目前計算單位的連結性非常低,遠遠未到達擁有意識的地步。前文曾經提過,若果電腦能通過圖靈測試,只代表它擁有智慧但不代表它擁有意識,這電腦可以是一隻懂得回應卻沒有意識的哲學殭屍。但若果IIT的分析方法表示它意識核心的連結複雜度堪比人腦,那是否就是它們擁有意識的一個客觀證據?

若果能證明AI擁有意識,它是否應該擁有權利?艾西莫夫的科幻小說雙百人( Bicentennial Man)裏面,機器人安德魯就先獲得了它的木雕創作的專利權(2022年8月美國聯邦法院才剛作出判決,AI 沒有獲得專利、版權的法律地位),最後獲得各種人權以及死亡的權利。2021年電影《爆機自由仁》(Free Guy),也因電玩中一個建基於人工神經網絡的非玩家角色(Non-Player Character)獲得了意識而令真實世界中的人類禁止遊戲公司關掉遊戲伺服器。

而在動物意識與權利方面,2012年劍橋意識宣言( The Cambridge Declaration on

Consciousness )裏就表明科學證據顯示哺乳類動物、鳥類以及八爪魚均擁有人類產生意識的神經基質,而2015 年紐西蘭國會就在法律上承認動物與人類一樣具有情感。歷史上,每次社會中一些群體獲得他們原本沒有的權利,社會必然產生翻天巨覆的變化。若果AI與動物被證明擁有意識,人類社會將會迎來巨變。

評論區 0