端傳媒新聞播客

當 AI 算法成為色情守門人,女性身體如何成為禁忌?|端聞 Podcast

00:00

/

--:--

在 Acast 開啟

收聽並關注「端聞」YouTube | Apple Podcasts | Spotify 或使用節目的 RSS Feed,在任意播客應用訂閱收聽。

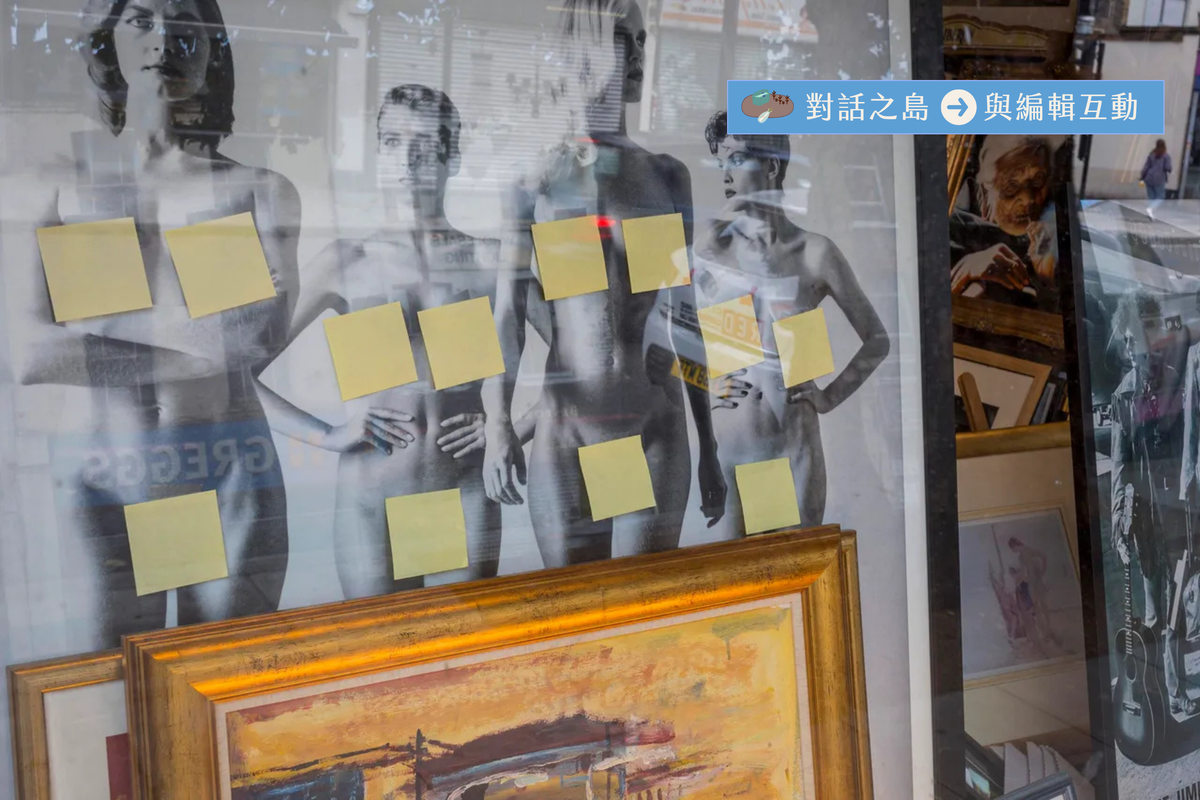

過去幾年,社群平台大量依賴演算法,來判定一則貼文是否違規。但在這套自動化的AI審查系統裡,「裸露」和「色情」往往被直接劃上等號,影像一旦觸及特定身體部位,就可能被判定為不當內容。

於是,性教育倡議者談論月經與身體構造的性教育影片被誤刪,長期投入性別倡議的創作者帳號一再消失;泌尿科醫師為了避開審查,只能用香蕉、手繪圖來替代生殖器示意;而呈現女性身體的藝術作品,即使毫無情色意圖,也經常在社群平台上遭到下架或限流。

到底,這些演算法是如何判斷何謂「色情內容」?又是根據什麼樣的資料與價值觀,去決定哪些身體可以被看見,哪些必須被隱藏?

本期「端聞」,端傳媒資深專題記者吳政霆,帶你瞭解那些算法背後的邏輯,以及算法如何產生偏見與誤判。

期待你跟我們分享想法,郵箱地址:podcast@theinitium.com

【製作團隊】

出品:端傳媒音頻

監製:甯卉

主持:甯卉

編輯:陳莉雅

製作人:Edison

剪輯、聲音設計:王伯維,「韁河媒體工作室」Alex Sun、阿狗

主題音樂:Axel Kacoutié

「有乳頭的車是性感的嗎?」當社群媒體成為色情守門人

演算法不懂疼痛、不懂羞辱,也看不見意圖;它只看見皮膚、乳頭、曲線,再決定這是否「女人該有的樣子」。